晉升業(yè)內(nèi)新寵兒,MoE模型給了AI行業(yè)兩條關(guān)鍵出路互聯(lián)網(wǎng)+

MoE模型火爆的背后:全新的AI解題思路

文 | 智能相對(duì)論

作者 | 陳泊丞

今年以來,MoE模型成了AI行業(yè)的新寵兒。

一方面,越來越多的廠商在自家的閉源模型上采用了MoE架構(gòu)。在海外,OpenAI的GPT-4、谷歌的Gemini、Mistral AI的Mistral、xAI的Grok-1等主流大模型都采用了MoE架構(gòu)。

而在國內(nèi),昆侖萬維推出的天工3.0、浪潮信息發(fā)布的源2.0-M32、通義千問團(tuán)隊(duì)發(fā)布的Qwen1.5-MoE-A2.7B、MiniMax全量發(fā)布的abab6、幻方量化旗下的DeepSeek發(fā)布的DeepSeek-MoE 16B等等也都屬于MoE模型。

另一方面,在MoE模型被廣泛應(yīng)用的同時(shí),也有部分廠商爭(zhēng)先開源了自家的MoE模型。前不久,昆侖萬維宣布開源2千億參數(shù)的Skywork-MoE。而在此之前,浪潮信息的源2.0-M32、DeepSeek的DeepSeek-MoE 16B等,也都紛紛開源。

為什么MoE模型如此火爆,備受各大廠商的青睞?在開源的背后,MoE模型又是以什么樣的優(yōu)勢(shì)使各大主流廠商成為其擁躉,試圖作為改變AI行業(yè)的利器?

MoE模型火爆的背后:全新的AI解題思路

客觀來說,MoE模型的具體工作原理更接近中國的一句古語“術(shù)業(yè)有專攻”,通過把任務(wù)分門別類,然后分給多個(gè)特定的“專家”進(jìn)行解決。

它的工作流程大致如此,首先數(shù)據(jù)會(huì)被分割為多個(gè)區(qū)塊(token),然后通過門控網(wǎng)絡(luò)技術(shù)(Gating Network)再把每組數(shù)據(jù)分配到特定的專家模型(Experts)進(jìn)行處理,也就是讓專業(yè)的人處理專業(yè)的事,最終匯總所有專家的處理結(jié)果,根據(jù)關(guān)聯(lián)性加權(quán)輸出答案。

當(dāng)然,這只是一個(gè)大致的思路,關(guān)于門控網(wǎng)絡(luò)的位置、模型、專家數(shù)量、以及MoE與Transformer架構(gòu)的具體結(jié)合方案,各家方案都不盡相同,也逐漸成為各家競(jìng)爭(zhēng)的方向——誰的算法更優(yōu),便能在這個(gè)流程上拉開MoE模型之間的差距。

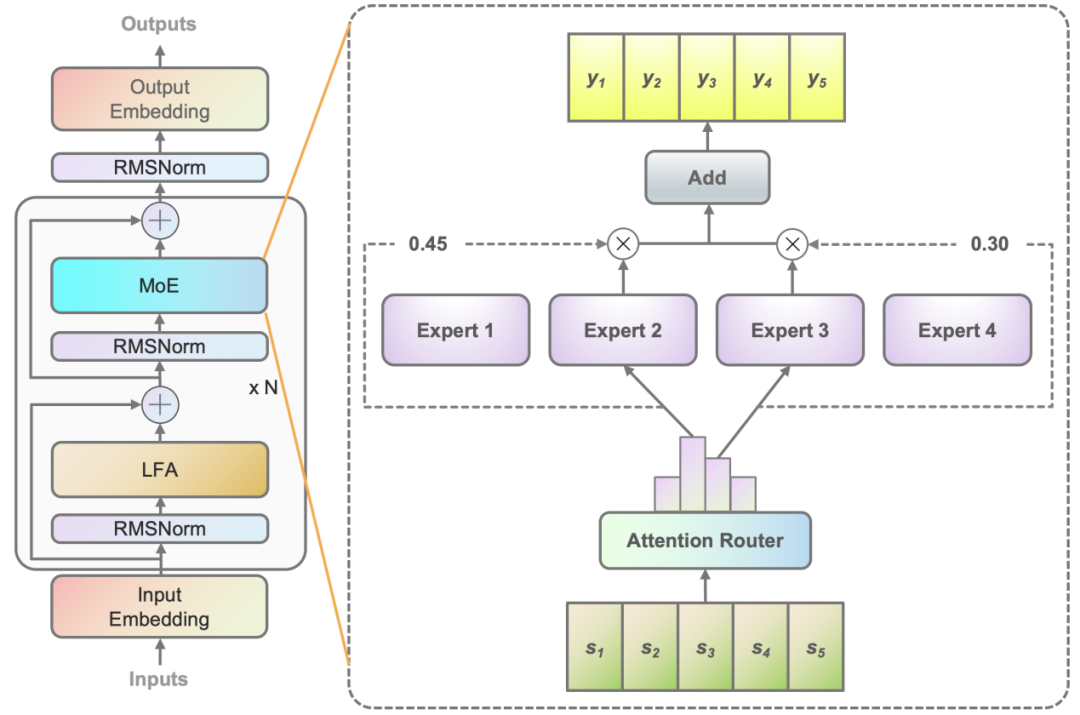

像浪潮信息就提出了基于注意力機(jī)制的門控網(wǎng)絡(luò)(Attention Router),這種算法結(jié)構(gòu)的亮點(diǎn)在于可以通過局部過濾增強(qiáng)的注意力機(jī)制(LFA, Localized Filtering-based Attention),率先學(xué)習(xí)相鄰詞之間的關(guān)聯(lián)性,然后再計(jì)算全局關(guān)聯(lián)性的方法,能夠更好地學(xué)習(xí)到自然語言的局部和全局的語言特征,對(duì)于自然語言的關(guān)聯(lián)語義理解更準(zhǔn)確,從而更好地匹配專家模型,保證了專家之間協(xié)同處理數(shù)據(jù)的水平,促使模型精度得以提升。

基于注意力機(jī)制的門控網(wǎng)絡(luò)(Attention Router)

拋開目前各家廠商在算法結(jié)構(gòu)上的創(chuàng)新與優(yōu)化不談,MoE模型這種工作思路本身所帶來的性能提升就非常顯著——通過細(xì)粒度的數(shù)據(jù)分割和專家匹配,從而實(shí)現(xiàn)了更高的專家專業(yè)化和知識(shí)覆蓋。

這使得MoE模型在處理處理復(fù)雜任務(wù)時(shí)能夠更準(zhǔn)確地捕捉和利用相關(guān)知識(shí),提高了模型的性能和適用范圍。因此,「智能相對(duì)論」嘗試了去體驗(yàn)天工3.0加持的AI搜索,就發(fā)現(xiàn)對(duì)于用戶較為籠統(tǒng)的問題,AI居然可以快速的完成拆解,并給出多個(gè)項(xiàng)目參數(shù)的詳細(xì)對(duì)比,屬實(shí)是強(qiáng)大。

天工AI搜索提問“對(duì)比一下小米su7和特斯拉model3”所得出的結(jié)果

由此我們可以看到,AI在對(duì)比兩款車型的過程中,巧妙地將這一問題拆解成了續(xù)航里程、動(dòng)力性能、外觀設(shè)計(jì)、內(nèi)飾設(shè)計(jì)、智能化與自動(dòng)駕駛、市場(chǎng)表現(xiàn)與用戶口碑、價(jià)格等多個(gè)項(xiàng)目,分別處理得出較為完整且專業(yè)的答案。

這便是“術(shù)業(yè)有專攻”的優(yōu)勢(shì)——MoE模型之所以受到越來越多廠商的關(guān)注,首要的關(guān)鍵就在于其所帶來的全新解決問題的思路促使模型的性能得到了較為顯著的提高。特別是伴隨著行業(yè)復(fù)雜問題的涌現(xiàn),這一優(yōu)勢(shì)將使得MoE模型得到更廣泛的應(yīng)用。

各大廠商爭(zhēng)先開源MoE模型:解決AI算力荒的另一條路徑

開源的意義在于讓MoE模型更好的普及。那么,對(duì)于市場(chǎng)而言,為什么要選擇MoE模型?

拋開性能來說,MoE模型更突出的一點(diǎn)優(yōu)勢(shì)則在于算力效率的提升。

DeepSeek-MoE 16B在保持與7B參數(shù)規(guī)模模型相當(dāng)?shù)男阅艿耐瑫r(shí),只需要大約40%的計(jì)算量。而37億參數(shù)的源2.0-M32在取得與700億參數(shù)LLaMA3相當(dāng)性能水平的同時(shí),所消耗的算力也僅為LLaMA3的1/19。

也就意味著,同樣的智能水平,MoE模型可以用更少的計(jì)算量和內(nèi)存需求來實(shí)現(xiàn)。這得益于MoE模型在應(yīng)用中并非要完全激活所有專家網(wǎng)絡(luò),而只需要激活部分專家網(wǎng)絡(luò)就可以解決相關(guān)問題,很好避免了過去“殺雞用牛刀”的尷尬局面。

舉個(gè)例子,盡管DeepSeek-MoE 16B的總參數(shù)量為16.4B,但每次推理只激活約2.8B的參數(shù)。與此同時(shí),它的部署成本較低,可以在單卡40G GPU上進(jìn)行部署,這使得它在實(shí)際應(yīng)用中更加輕量化、靈活且經(jīng)濟(jì)。

在當(dāng)前算力資源越來越緊張的“算力荒”局面下,MoE模型的出現(xiàn)和應(yīng)用可以說為行業(yè)提供了一個(gè)較為現(xiàn)實(shí)且理想的解決方案。

更值得一提的是,MoE模型還可以輕松擴(kuò)展到成百上千個(gè)專家,使得模型容量極大增加,同時(shí)也允許在大型分布式系統(tǒng)上進(jìn)行并行計(jì)算。由于各個(gè)專家只負(fù)責(zé)一部分?jǐn)?shù)據(jù)處理,因此在保持模型性能的同時(shí),又能顯著降低了單個(gè)節(jié)點(diǎn)的內(nèi)存和計(jì)算需求。

如此一來,AI能力的普惠便有了非常可行的路徑。這樣的特性再加上廠商開源,將促使更多中小企業(yè)不需要重復(fù)投入大模型研發(fā)以及花費(fèi)過多算力資源的情況下便能接入AI大模型,獲取相關(guān)的AI能力,促進(jìn)技術(shù)普及和行業(yè)創(chuàng)新。

當(dāng)然,在這個(gè)過程中,MoE模型廠商們?cè)跒槭袌?chǎng)提供開源技術(shù)的同時(shí),也有機(jī)會(huì)吸引更多企業(yè)轉(zhuǎn)化成為付費(fèi)用戶,進(jìn)而走通商業(yè)化路徑。畢竟,MoE模型的優(yōu)勢(shì)擺在眼前,接下來或許將有更多的企業(yè)斗都會(huì)嘗試新的架構(gòu)來拓展AI能力,越早開源越能吸引更多市場(chǎng)主體接觸并參與其中。

但是,開源最關(guān)鍵的優(yōu)勢(shì)還是在于MoE模型對(duì)當(dāng)前算力問題的解決。或許,隨著MoE模型被越來越多的企業(yè)所接受并應(yīng)用,行業(yè)在獲得相應(yīng)AI能力的同時(shí)也不必困頓于算力資源緊張的問題了。

寫在最后

MoE大模型作為當(dāng)前人工智能領(lǐng)域的技術(shù)熱點(diǎn),其獨(dú)特的架構(gòu)和卓越的性能為人工智能的發(fā)展帶來了新的機(jī)遇。不管是應(yīng)用還是開源,隨著技術(shù)的不斷進(jìn)步和應(yīng)用場(chǎng)景的不斷拓展,MoE大模型有望在更多領(lǐng)域發(fā)揮巨大的潛力。

MoE模型的本質(zhì)在于為AI行業(yè)的發(fā)展提供了兩條思路,一是解決應(yīng)用上的性能問題,讓AI有了更強(qiáng)大的解題思路。二是解決算力上的欠缺問題,讓AI有了更全面的發(fā)展空間。由此來看MoE模型能成為行業(yè)各大廠商的寵兒,也是水到渠成的事情。

*本文圖片均來源于網(wǎng)絡(luò)

此內(nèi)容為【智能相對(duì)論】原創(chuàng),

僅代表個(gè)人觀點(diǎn),未經(jīng)授權(quán),任何人不得以任何方式使用,包括轉(zhuǎn)載、摘編、復(fù)制或建立鏡像。

部分圖片來自網(wǎng)絡(luò),且未核實(shí)版權(quán)歸屬,不作為商業(yè)用途,如有侵犯,請(qǐng)作者與我們聯(lián)系。

?AI產(chǎn)業(yè)新媒體;

?澎湃新聞科技榜單月度top5;

?文章長期“霸占”鈦媒體熱門文章排行榜TOP10;

?著有《人工智能 十萬個(gè)為什么》

?【重點(diǎn)關(guān)注領(lǐng)域】智能家電(含白電、黑電、智能手機(jī)、無人機(jī)等AIoT設(shè)備)、智能駕駛、AI+醫(yī)療、機(jī)器人、物聯(lián)網(wǎng)、AI+金融、AI+教育、AR/VR、云計(jì)算、開發(fā)者以及背后的芯片、算法等。

1.TMT觀察網(wǎng)遵循行業(yè)規(guī)范,任何轉(zhuǎn)載的稿件都會(huì)明確標(biāo)注作者和來源;

2.TMT觀察網(wǎng)的原創(chuàng)文章,請(qǐng)轉(zhuǎn)載時(shí)務(wù)必注明文章作者和"來源:TMT觀察網(wǎng)",不尊重原創(chuàng)的行為TMT觀察網(wǎng)或?qū)⒆肪控?zé)任;

3.作者投稿可能會(huì)經(jīng)TMT觀察網(wǎng)編輯修改或補(bǔ)充。