奇富科技語音情感計算論文入選國際AI學術頂級會議ICASSP 2024快訊

奇富科技自研MS-SENet音頻情感計算網絡框架 奇富科技團隊認為可以從減少提取大量無關緊要的聲學特征和針對局部頻率和長期時間特征進行融合兩方面去提升語音信號的情感表征學習,奇富科技的語音情感計算研究不止于理論突破,進一步提高了情感計算模型的表達能力。

【TechWeb】12月27日消息,2024年IEEE聲學、語音與信號處理國際會議ICASSP 2024(2024 IEEE International Conference on Acoustics, Speech, and Signal Processing)宣布錄用奇富科技關于語音情感計算的最新研究成果論文“MS-SENet: Enhancing Speech Emotion Recognition Through Multi-scale Feature Fusion With Squeeze-and-excitation Blocks”。

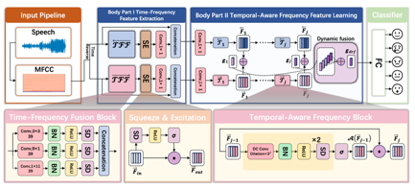

奇富科技介紹,此次被錄用的論文研究方向聚焦在語音情感計算,團隊提出了一種名為MS-SENet的新型網絡結構,通過高效提取、選擇和加權空間和時間多尺度特征,并將這些特征與原始信息相融合,獲得更強的語音情緒表征向量。

情感計算領域是一個涉及計算機科學、心理學和語言學等多學科的交叉研究領域,它的主要目的是通過分析和處理語音信號中的情感信息,使計算機能夠識別和理解人類的情感狀態。業界主流做法是通過音頻、文本等多模態信息來進行情感分類,但奇富科技團隊認為人類底層情感特征是相通的,是完全可以跨越具體語種和文本內容。

奇富科技自研MS-SENet音頻情感計算網絡框架

奇富科技團隊認為可以從減少提取大量無關緊要的聲學特征和針對局部頻率和長期時間特征進行融合兩方面去提升語音信號的情感表征學習,并基于此提出了MS-SENet框架。MS-SENet通過使用不同尺寸的卷積核提取多尺度時空特征,并引入壓勵模塊來有效捕捉這些多尺度特征。同時通過跳躍連接和空間丟失層防止過擬合并增加模型深度,進一步提高了情感計算模型的表達能力。

另外,奇富科技團隊在論文中評估了包括中科院自動化所語音情感數據集、柏林情感數據庫、意大利語數據集、互動情感二元運動捕捉數據庫、Surrey音頻視覺表達情感數據集以及Ryerson音頻視覺情感演講與歌曲數據集在內的六個不同場景的多語種的數據集。和SOTA(state of the art,是指在特定任務中目前表現最優的方法或模型)相比,MS-SENet將UA和WA提高了1.31%和1.61%,同時MS-SENet在具有更多情感類別和較低數據量的情況下,仍然保持著出色的情感識別能力。

據介紹,奇富科技的語音情感計算研究不止于理論突破,更是有成功的實際應用。例如,在貸后降投訴項目中,異常情緒監測首次被應用在實景業務當中。通過對高風險客群的錄音通話進行逐通分析,及時遴選出異常情緒的客戶,以便相關人員可以及時介入,實驗結果表明模型組投訴率低于對照組4個絕對值百分點。

1.TMT觀察網遵循行業規范,任何轉載的稿件都會明確標注作者和來源;

2.TMT觀察網的原創文章,請轉載時務必注明文章作者和"來源:TMT觀察網",不尊重原創的行為TMT觀察網或將追究責任;

3.作者投稿可能會經TMT觀察網編輯修改或補充。