阿里云宣布Qwen2開(kāi)源 性能超美國(guó)開(kāi)源模型Llama3快訊

Qwen2-57B-A14B-Instruct則能處理64k的上下文長(zhǎng)度,Qwen2-72B-Instruct能夠完美處理128k上下文長(zhǎng)度內(nèi)的信息抽取任務(wù),Qwen2-7B-Instruct幾乎完美地處理長(zhǎng)達(dá)128k的上下文。

【TechWeb】6月7日消息,阿里云今日宣布,比美國(guó)開(kāi)源Llama3和中國(guó)閉源模型們更強(qiáng)的Qwen2今日開(kāi)源,免費(fèi)下載。

阿里云表示:歷經(jīng)數(shù)月努力,我們很高興迎來(lái)了Qwen系列模型從Qwen1.5到Qwen2的重大升級(jí)。這一次,我們?yōu)榇蠹規(guī)?lái)了:

* 5個(gè)尺寸的預(yù)訓(xùn)練和指令微調(diào)模型, 包括Qwen2-0.5B、Qwen2-1.5B、Qwen2-7B、Qwen2-57B-A14B以及Qwen2-72B;

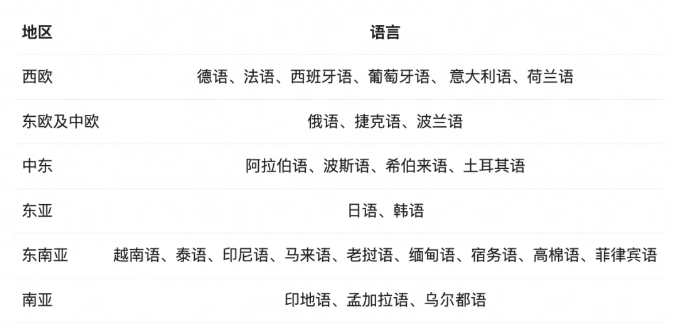

* 在中文英語(yǔ)的基礎(chǔ)上,訓(xùn)練數(shù)據(jù)中增加了27種語(yǔ)言相關(guān)的高質(zhì)量數(shù)據(jù);

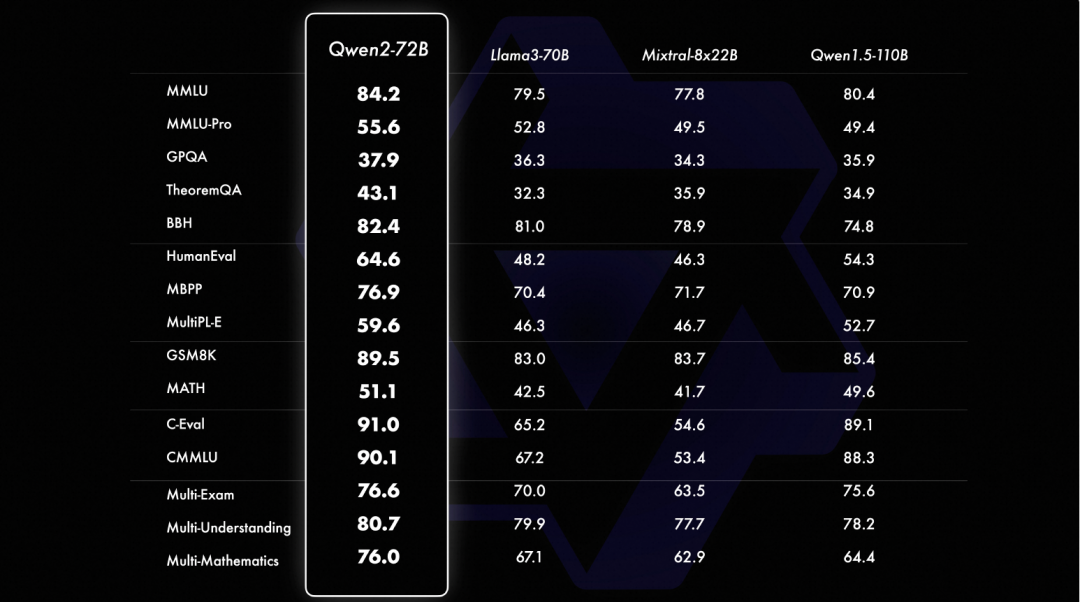

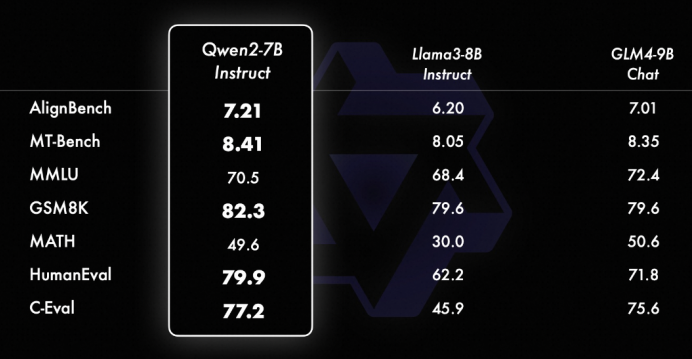

* 多個(gè)評(píng)測(cè)基準(zhǔn)上的領(lǐng)先表現(xiàn);

* 代碼和數(shù)學(xué)能力顯著提升;

* 增大了上下文長(zhǎng)度支持,最高達(dá)到128K tokens(Qwen2-72B-Instruct)。

Qwen2-72B-Instruct能夠完美處理128k上下文長(zhǎng)度內(nèi)的信息抽取任務(wù);Qwen2-7B-Instruct幾乎完美地處理長(zhǎng)達(dá)128k的上下文;Qwen2-57B-A14B-Instruct則能處理64k的上下文長(zhǎng)度;而該系列中的兩個(gè)較小模型則支持32k的上下文長(zhǎng)度。

目前,上述Qwen2系列模型已在Hugging Face和ModelScope上同步開(kāi)源。

阿里云強(qiáng)調(diào),此次采用不同的模型許可。除了Qwen2-72B依舊使用此前的Qianwen License外,其余模型,包括Qwen2-0.5B、Qwen2-1.5B、Qwen2-7B以及Qwen2-57B-A14B在內(nèi),均采用Apache 2.0的許可。我們希望本次開(kāi)放程度的提升能夠加速Q(mào)wen2在全球各地的落地及商業(yè)應(yīng)用。

1.TMT觀察網(wǎng)遵循行業(yè)規(guī)范,任何轉(zhuǎn)載的稿件都會(huì)明確標(biāo)注作者和來(lái)源;

2.TMT觀察網(wǎng)的原創(chuàng)文章,請(qǐng)轉(zhuǎn)載時(shí)務(wù)必注明文章作者和"來(lái)源:TMT觀察網(wǎng)",不尊重原創(chuàng)的行為T(mén)MT觀察網(wǎng)或?qū)⒆肪控?zé)任;

3.作者投稿可能會(huì)經(jīng)TMT觀察網(wǎng)編輯修改或補(bǔ)充。